MCP Server là gì? Tại sao dân AI cần hiểu ngay

MCP Server — lớp giao tiếp chuẩn hóa giữa LLM và các hệ thống bên ngoài. Tìm hiểu cách nó thay đổi cách chúng ta xây dựng AI workflow.

Nguyễn Nhật Long

@nguyennhatlong1303

Nếu bạn đang làm việc với LLM hay bất kỳ hệ thống AI nào phức tạp hơn một cái chatbot đơn giản, mình cá là bạn đã từng đau đầu với câu hỏi: "Làm sao để con model này nói chuyện được với hệ thống kia?". Mình cũng vậy. Và đó chính xác là lý do MCP Server ra đời.

Vấn đề thực tế mà ai làm AI cũng gặp

Thử tưởng tượng bạn đang build một hệ thống data analytics. Bạn có một LLM để phân tích text, một model khác để ra quyết định, rồi còn database, API bên thứ ba, và một đống agent tự động chạy ngầm. Câu hỏi là: làm sao để tất cả những thứ này phối hợp với nhau mà không thành một mớ spaghetti code?

Theo kinh nghiệm của mình, trước khi có khái niệm MCP, mỗi lần integrate một tool mới vào LLM workflow là mỗi lần viết custom adapter. Model A cần format JSON kiểu này, model B cần kiểu khác, tool C thì cần gọi qua REST API với authentication riêng. Mỗi integration là một snowflake không cái nào giống cái nào.

Điều này không scale được. Và đó là pain point mà MCP Server giải quyết.

MCP Server — Hiểu đơn giản trong 2 phút

MCP viết tắt của Model Communication Protocol (hay còn gọi là Model Context Protocol trong một số tài liệu). Bạn có thể hiểu nó như thế này:

MCP Server là một lớp trung gian chuẩn hóa cách LLM giao tiếp với các hệ thống, tool, và data source bên ngoài.

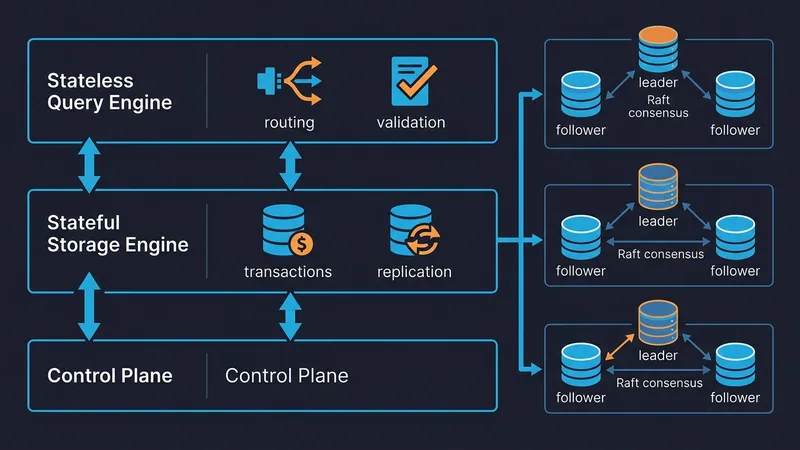

Nếu bạn từng làm web, hãy nghĩ về nó như một API Gateway nhưng dành cho AI. Thay vì mỗi model tự đi gọi từng service riêng lẻ với protocol riêng, tất cả đều đi qua MCP Server. Server này đảm nhận việc:

- Translate: Chuyển đổi format dữ liệu giữa các hệ thống

- Route: Điều hướng request đến đúng service, đúng model

- Orchestrate: Quản lý thứ tự và timing của các agent trong workflow

Nói nôm na, MCP Server là "người phiên dịch" đảm bảo mọi thành phần trong hệ thống AI của bạn nói cùng một ngôn ngữ.

3 việc MCP Server làm tốt nhất

Kết nối nhiều LLM cùng lúc

Thực tế bây giờ hiếm có hệ thống nào chỉ dùng một model duy nhất. Bạn có thể dùng GPT cho text generation, dùng một model chuyên biệt cho classification, rồi thêm một model nữa cho summarization. Vấn đề là mỗi model có input/output format khác nhau.

MCP Server đứng giữa, nhận output từ model A, transform sang format mà model B cần, rồi forward đi. Không cần viết glue code cho từng cặp model nữa.

Điều mình thấy hay là cách tiếp cận này giống hệt pattern message broker trong microservices. Chúng ta không phát minh lại bánh xe chỉ đang áp dụng một pattern đã proven vào thế giới AI.

Orchestrate agent-based workflow

Đây là phần mình thấy powerful nhất. Khi bạn build một hệ thống với nhiều AI agent ví dụ một agent lo data quality check, một agent lo categorization, một agent lo alerting bạn cần một "nhạc trưởng" để điều phối.

MCP Server đóng vai trò đó. Nó quản lý:

- Agent nào được trigger khi nào

- Input của agent này là output của agent nào

- Xử lý lỗi và retry khi một agent fail

- Đảm bảo các agent không race condition với nhau

Không có lớp orchestration này, bạn sẽ phải hardcode logic điều phối vào từng agent. Và tin mình đi, maintain cái đó là ác mộng.

Transform và route data

Khi hệ thống AI scale lên, data volume tăng theo cấp số nhân. Data đến từ nhiều source, nhiều format, nhiều tốc độ khác nhau. MCP Server xử lý việc:

- Normalize data về format chuẩn trước khi đưa vào model

- Route data đến đúng pipeline dựa trên content type hoặc business rule

- Buffer và batch data khi cần để tối ưu throughput

Nếu bạn đang làm data engineering, bạn sẽ thấy điều này quen thuộc nó giống ETL pipeline nhưng được design cho real-time AI workflow.

Khi nào bạn thực sự cần MCP Server?

Mình nói thẳng: không phải project nào cũng cần MCP Server. Nếu bạn chỉ đang build một chatbot đơn giản gọi API OpenAI, thì thêm MCP Server vào là over-engineering.

Nhưng bạn nên nghiêm túc cân nhắc khi:

- Hệ thống dùng 2+ model cần phối hợp với nhau

- Có nhiều AI agent chạy autonomous và cần sync

- Data flow phức tạp nhiều source, nhiều destination, cần transform

- Cần scale thêm model mới, thêm tool mới mà không muốn rewrite integration

- Team lớn nhiều người cùng develop các phần khác nhau của AI pipeline

Theo kinh nghiệm của mình, điểm tipping point thường là khi bạn có hơn 3 integration points. Lúc đó, chi phí maintain custom adapter bắt đầu vượt qua chi phí setup MCP Server.

So sánh với cách làm truyền thống

Để bạn hình dung rõ hơn sự khác biệt:

Không có MCP Server:

- Model A gọi trực tiếp Model B qua custom API

- Mỗi integration cần adapter riêng

- Thêm model mới = sửa code ở nhiều chỗ

- Error handling phân tán, khó debug

Có MCP Server:

- Tất cả model giao tiếp qua protocol chuẩn

- Thêm model mới = register với MCP Server, xong

- Centralized logging và error handling

- Dễ monitor, dễ scale, dễ maintain

Pattern này không mới. Nó giống chuyển từ point-to-point integration sang dùng message bus trong microservices. Bài học cũ, context mới.

Một vài điều cần lưu ý

MCP Server không phải silver bullet. Có vài trade-off bạn cần biết:

- Thêm một layer = thêm latency. Nếu workflow của bạn cần response trong milliseconds, cần benchmark kỹ.

- Single point of failure. MCP Server mà down thì cả hệ thống đứng. Cần plan cho high availability.

- Learning curve. Team cần thời gian để hiểu protocol và convention mới.

- Debugging complexity. Khi có vấn đề, bạn phải trace qua thêm một layer nữa.

Mình không nói để scare bạn, mà để bạn đưa ra quyết định informed. Mọi architectural decision đều có trade-off.

Những điều đáng nhớ

- MCP Server là lớp chuẩn hóa giao tiếp giữa LLM, agent, và external system

- Nó giải quyết 3 bài toán chính: multi-model communication, agent orchestration, và data routing

- Phù hợp nhất cho hệ thống AI phức tạp với nhiều integration points

- Không phải lúc nào cũng cần đừng over-engineer

- Trade-off chính: thêm latency, thêm complexity, nhưng đổi lại scalability và maintainability

Cá nhân mình tin rằng MCP Server (hoặc một concept tương tự) sẽ trở thành standard trong AI infrastructure, giống như API Gateway đã trở thành standard trong microservices. Thế giới AI đang đi từ "một model làm mọi thứ" sang "nhiều model và agent phối hợp", và chúng ta cần một protocol chuẩn để kết nối tất cả lại.

Nếu bạn đang bắt đầu tìm hiểu, hãy thử setup một MCP Server đơn giản với 2-3 tool integration trước. Cảm nhận cách nó hoạt động, rồi mới quyết định có áp dụng vào production hay không. Đừng nghe ai nói hay rồi all-in hãy tự kiểm chứng.

Nguyễn Nhật Long

@nguyennhatlong1303Nguyễn Nhật Long is a Senior Frontend Engineer and Frontend Team Leader with 7 years of experience building real-time fintech platforms. Specializing in React, Next.js, TypeScript, and React Native, shipping 10+ products across Web, Mobile, Telegram Mini-Apps, and Web3.

Thấy hay? Chia sẻ cho bạn bè!

Bài viết liên quan

Có thể bạn cũng thích

Tolaria Quản lý knowledge base bằng Markdown như dân chuyên nghiệp

Tolaria là desktop app open source giúp quản lý knowledge base bằng markdown files, git-first, offline-first. Đây có thể là thứ bạn đang thiếu cho second brain.

Tại sao AI vẫn tệ với Front-end?

AI có thể generate cả thế giới 3D, video, hình ảnh — nhưng tại sao nó vẫn chật vật với CSS và UI bespoke? Cùng mổ xẻ lý do nhé.

Uber đã trị database overload như thế nào: Từ rate-limiting tĩnh đến load manage

Uber giảm ~70% P99 latency nhờ chuyển từ quota-based rate limiting sang intelligent load manager sát storage layer. Bài học cho mọi hệ thống stateful database.